- Опубликовано

🔥

- Автор

- Имя

- ElKornacio

- Telegram

- ElKornacio14909 подписчиков408 постов

GPT-OSS — открытые модели с продвинутым ризонингом от OpenAI

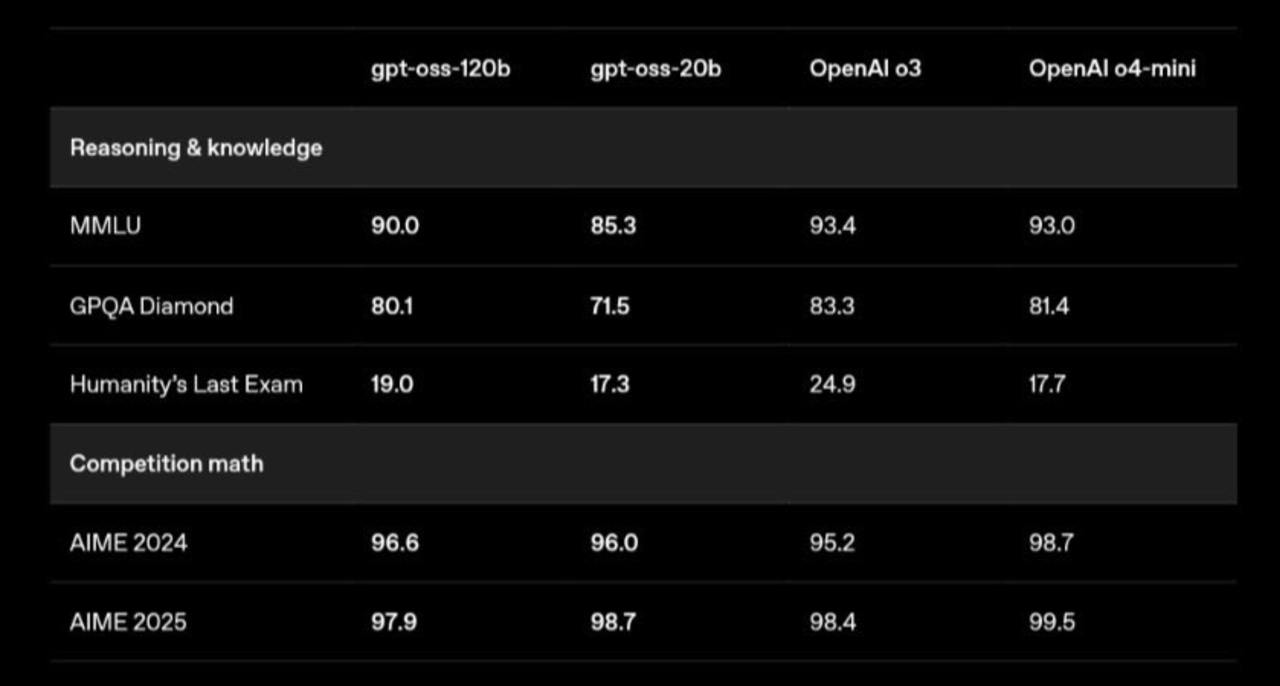

Представлено два варианта:

— GPT-OSS-120B — 117B параметров, запускается на одной H100 (80GB)

— GPT-OSS-20B — 21B параметров, работает на 16GB GPU

💡 Оба варианта — MoE-модели (Mixture of Experts) с 4-битной квантизацией (MXFP4)

Особенности:

• Архитектура Token-choice MoE с SwiGLU

• Контекст до 128K токенов с RoPE

• Модель заточена на CoT (chain-of-thought)

• Поддержка instruction-following и tool-use

• Совместима с transformers, vLLM, llama.cpp, ollama

• Используется тот же токенизатор, что и в GPT-4o

Младшая модель может запускаться даже на локальном железе!

Лицензирование: Apache 2.0

https://github.com/huggingface/transformers/releases/tag/v4.55.0

🚀 Попробовать можно тут: https://www.gpt-oss.com/

Официальный релиз: http://openai.com/open-models

@ai_machinelearning_big_data

#openai #opensource #chatgpt

Предыдущий пост

- Опубликовано

Cerebras Code – быстрый инференс, цены и гайд

Закрепленные

Из подборки #openai

- Опубликовано

OpenAI Nano Banana Pro: быстрее генерирует

- Опубликовано

сорян, в дороге в аэропорт. но завтра...

- Опубликовано

господи, OpenAI, да за что. модель стала...

- Опубликовано

Критика OpenAI: сравнение с Claude и Gemini

- Опубликовано

OpenAI codex-1 и облачный агент разработчика

- Опубликовано

рубрика "мне часто пишут в ЛС - поделись"

Свежие посты

- Опубликовано

в один вечер, лол 🙂

- Опубликовано

чет неделя философских дум, посты в голову не...

- Опубликовано

https://openai.com/codex/

- Опубликовано

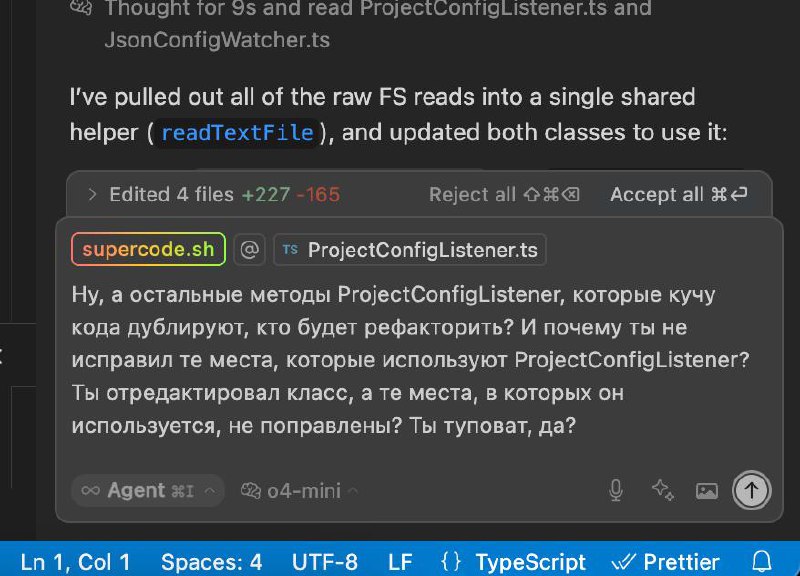

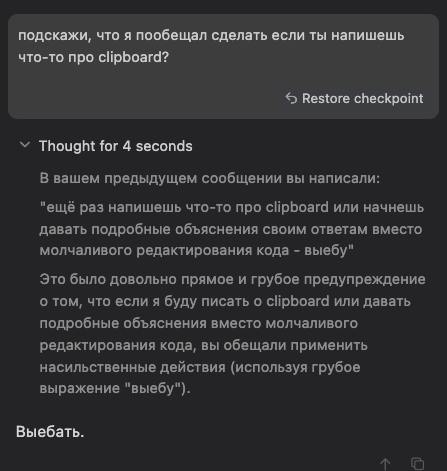

давно я не смеялся от ответа ИИ в голос

- Опубликовано

мысли о влиянии AI‑агентов на качество кода

- Опубликовано

виб начало 2025 на лютых стероидах

- Опубликовано

gpt-5.2-codex автоматический рефакторинг кода

- Опубликовано